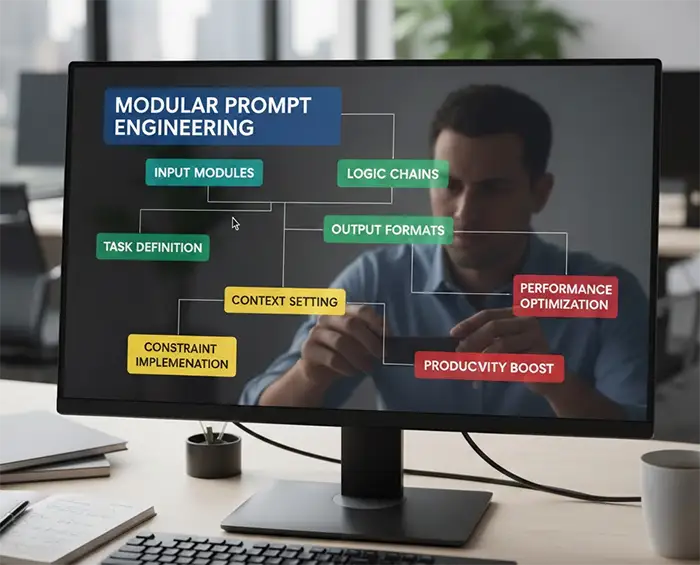

La interacción con la Inteligencia Artificial, ya sea a través de ChatGPT, Claude o Midjourney, ha evolucionado de ser una curiosidad experimental a una necesidad crítica en los flujos de trabajo modernos. Sin embargo, la mayoría de los profesionales still enfrentan una barrera invisible: la frustración de obtener resultados mediocres a pesar de dedicar mucho tiempo a escribir instrucciones. El problema no es la capacidad del modelo, sino la falta de estructura en la comunicación. Este artículo aborda la técnica del Prompt Engineering Modular, una metodología diseñada para transformar peticiones desordenadas en sistemas lógicos, garantizando respuestas precisas, consistentes y replicables, ahorrando horas de corrección manual.

Qué es el Prompt Engineering Modular y por qué es importante

El Prompt Engineering Modular es un enfoque sistemático para la construcción de instrucciones a la IA que divide la petición global en componentes independientes o «módulos». En lugar de escribir un párrafo largo y denso —similar a una prosa literaria—, este método trata la solicitud como si se estuviera programando software, asignando variables y funciones específicas para cada aspecto de la tarea.

Su importancia en la productividad digital radica en la previsibilidad y el control. Cuando se escribe un prompt de forma tradicional, la IA a menudo prioriza partes equivocadas de la frase o malinterpreta el contexto por falta de claridad sintáctica. El enfoque modular elimina la ambigüedad, permitiendo al usuario aislar variables (como el tono, el formato o el público objetivo) y modificarlas individualmente sin tener que reescribir toda la instrucción desde cero. Es la diferencia entre pedirle a un albañil «construya algo bonito» y entregarle unos planos arquitectónicos detallados.

Problemas más comunes asociados al tema

Los usuarios que no aplican una estructura modular suelen enfrentar una serie de recurrentes dolores de cabeza que sabotean su eficiencia:

- Alucinaciones por falta de contexto: La IA inventa datos o rellena huecos con información irrelevante porque el marco de referencia no está claramente delimitado.

- Inconsistencia en formatos: Al pedir generar múltiples entradas de datos (por ejemplo, una lista de correos), la IA cambia el estructura entre un elemento y otro, obligando al usuario a editar manualmente cada resultado.

- Dificultad para iterar: Si el resultado no es el deseado, el usuario tiende a añadir más texto al final del prompt («pero hazlo más divertido»), lo que a menudo confunde al modelo y degrada la calidad inicial.

- Ignorancia de restricciones negativas: La IA a menudo incluye elementos que se querían evitar, simplemente porque no se establecieron límites claros (módulos de exclusión).

- Pérdida de tiempo en «ajuste fino»: Se pasa más tiempo puliendo la respuesta de la IA que la que se habría tardado en redactar el contenido original, anulando el beneficio de la automatización.

Causas principales

Entender por qué ocurren estos fallos requiere mirar brevemente bajo el capó de los Modelos de Lenguaje Grande (LLM). Estas herramientas funcionan mediante mecanismos de atención probabilística. Cuando se introduce una «pared de texto» no estructurada, el modelo distribuye su «atención» de manera difusa.

- Falta de jerarquía semántica: Sin delimitadores claros (como comillas, guiones o encabezados), el modelo no sabe qué parte de la instrucción es el «rol», cuál es la «tarea» y cuál es el «formato». Esto lleva a que una instrucción de estilo anule una restricción técnica importante.

- Interferencia de ruido: Los modelos de IA intentan procesar cada palabra. Un prompt conversacional con muchas muletillas («por favor», «ojalá puedas», «necesito que») añade ruido que desvía al modelo del objetivo principal. La técnica modular funciona como un filtro de ruido natural.

- Falta de anclaje de contexto: La memoria de contexto de la IA es limitada y lineal. Sin modularidad, si el prompt es largo, el modelo puede «olvidar» la instrucción dada al principio para centrarse en la del final (un fenómeno conocido como «lost in the middle»).

Soluciones prácticas paso a paso

Implementar el Prompt Engineering Modular requiere cambiar el hábito de escribir como se habla a escribir como se configura un sistema. Sigue estos pasos para optimizar tus resultados:

- Define la Estructura de 4 Pilares: Para cualquier prompt complejo, utiliza esta plantilla base:

[Rol]:¿Quién es la IA? (Experto en SEO, Poeta, Programador Python).[Contexto]:¿Cuál es el trasfondo? (Estoy escribiendo para un blog de tecnología, la audiencia son principiantes).[Instrucción/Tarea]:¿Qué debe hacer exactamente? (Escribe un outline de 500 palabras).[Formato/Restricciones]:¿Cómo debe verse? (Usa viñetas, no uses jerga, máx 3 párrafos).

- Utiliza Delimitadores Claros: Separa cada módulo visualmente usando triple comilla

""", signos de numeral###o guiones medios. Esto indica a la IA dónde empieza y termina cada sección.- Ejemplo:

### Rol ###Actúa como consultor financiero.### Tarea ###Analiza el siguiente texto...

- Ejemplo:

- Aísla las Variables para Iteración: Si vas a generar varias versiones del mismo contenido, crea un módulo exclusivamente para las variables cambiantes.

- Ejemplo:

### Variable ###[Estilo de escritura: Formal]. Para la siguiente prueba, solo cambias «Formal» por «Humorístico» en esa línea específica, sin tocar el resto del prompt complejo.

- Ejemplo:

- Implementa el Módulo de «Ejemplos» (Few-Shot Prompting): Este es un paso avanzado crucial. Añade un módulo que muestre a la IA exactamente lo que buscas.

- Instrucción: «Genera 5 títulos de artículos.»

- Módulo de Ejemplo: «Ejemplos de formato deseado: 1. Título: [Título aquí] – Descripción: [Descripción aquí]».

- Cadenas de Prompts (Chaining): No intentes hacerlo todo en un solo prompt gigante. Divide el trabajo en módulos secuenciales.

- Prompt 1: Generar ideas de blog.

- Prompt 2: Tomar la idea 1 y expandirla.

- Prompt 3: Tomar la expansión y convertirla en código HTML. Esto reduce la carga cognitiva de la IA y mejora la precisión de cada etapa.

.png)

Consejos, buenas prácticas y recomendaciones finales

- Guarda tus Plantillas: La productividad real viene de no volver a escribir lo mismo. Usa herramientas como TextExpander o simplemente un documento de Notion con tus módulos favoritos prefabricados.

- Lenguaje «If-Then»: En el módulo de restricciones, usa lógica condicional. Ejemplo: «Si no estás seguro de un dato, indícalo explícitamente en lugar de inventarlo». Esto reduce drásticamente las alucinaciones.

- Ajuste de Temperatura: Si la plataforma lo permite (como la API de OpenAI), gestiona el parámetro de temperatura en tu «mentalidad modular». Para tareas creativas, permite más aleatoriedad; para tareas de programación o datos, exige «temperatura cero» (máxima precisión).

- Auditoría de Salida: Revisa siempre qué módulo falló. Si el tono es incorrecto, no reescribas todo el prompt; ve al módulo de

[Rol]o[Tono]y ajústalo específicamente. Esto es la esencia de la depuración modular.

Tabla Comparativa de Enfoques

| Característica | Prompting Tradicional (Conversacional) | Prompt Engineering Modular |

|---|---|---|

| Estructura | Párrafos largos, narrativos. | Fragmentados, delimitados, sintácticos. |

| Reutilización | Baja. Debes reescribir todo para cambios pequeños. | Alta. Cambias solo el módulo afectado. |

| Precisión | Variable, dependiente de la «suerte» del modelo. | Alta, controlada por delimitadores claros. |

| Curva de Aprendizaje | Fácil de empezar, difícil de dominar. | Requiere práctica inicial, pero escala mejor. |

| Depuración | Difícil identificar el error. | Fácil aislar el módulo problemático. |

Ejemplos reales o escenarios prácticos

Escenario A: Creación de un Newsletter Semanal (Marketing Digital)

- Enfoque Ineficiente: «Hola, necesito que me escribas un correo para mis clientes vendiendo este nuevo curso de cocina, que sea divertido y que hable de los ingredientes, y que tenga un botón de compra y que no sea muy largo.»

- Resultado: El correo suele perder el foco, olvidar el botón o mezclar el tono divertido con la venta agresiva.

- Enfoque Modular:

### ROL ###Copywriter experto en email marketing estilo gastronómico.### CONTEXTO ###Lanzamiento del curso «Masterchef en Casa». Público objetivo: aficionados a la cocina con poco tiempo.### TAREA ###Escribir un correo de venta (sequence email #1).### RESTRICCIONES ###- Longitud: Máx 150 palabras.

- Tono: Entusiasta pero no agresivo.

- Formato: Usar negritas para beneficios clave. Incluir CTA: «Únete al curso aquí».

### ESTRUCTURA ###Saludo emocional -> Problema (falta de tiempo) -> Solución (el curso) -> CTA.

Escenario B: Generación de Código Python (Desarrollo)

- Enfoque Modular:

### ROL ###Desarrollador Senior Python.### OBJETIVO ###Crear un script de web scraping.### LIBRERÍAS ###Usar BeautifulSoup y requests únicamente.### EXCLUSIONES ###No usar Selenium ni Scrapy.### SALIDA ###Proporcionar solo el bloque de código con comentarios explicando cada paso.

Conclusión

La adopción del Prompt Engineering Modular no es simplemente una cuestión de «escribir mejor»; es una transformación fundamental en cómo nos relacionamos con la tecnología de productividad. Al treating los prompts como conjuntos de bloques de construcción intercambiables, pasamos de ser usuarios pasivos que esperan un milagro a arquitectos activos que diseñan soluciones. Esta técnica elimina la frustración de la aleatoriedad, reduce drásticamente el tiempo de edición y permite escalar la producción de contenido de manera consistente. Empieza hoy a desglosar tus instrucciones en módulos; notarás que la IA deja de «adivinar» y empieza a ejecutar tus órdenes con una precisión que antes parecía imposible.